|

| Stephen Hawking y otros científicos piden la prohibición de los "robots asesinos" |

Fuente:agencias

EEUU.,29/07/2015(El Pueblo en Línea)-Miles de investigadores y de personalidades del mundo científico, entre ellos el célebre astrofísico Stephen Hawking, han lanzado un llamamiento para pedir la prohibición de las armas ofensivas autónomas, los llamados "robots asesinos".

"Las armas autónomas seleccionan y atacan objetivos sin intervención humana", recuerda la carta, publicada este martes coincidiendo con la apertura de la Conferencia Internacional Conjunta de Inteligencia Artificial (IJCAI, por sus siglas en inglés) en Buenos Aires (Argentina).

La tecnología de la Inteligencia Artificial (IA) ha alcanzado un punto en que el despliegue de estas armas será una posibilidad técnica (si no legal) en a?os, no décadas, y hay mucho en juego", según indica un texto firmado por varios científicos del mundo.

"La tecnología de la Inteligencia Artificial (IA) ha alcanzado un punto en que el despliegue de estas armas será una posibilidad técnica (si no legal) en a?os, no décadas, y hay mucho en juego", a?aden los firmantes, entre ellos investigadores y profesores de Harvard, Berkeley, Cambridge, París o Berlín.

También figuran entre los firmantes el empresario de altas tecnologías Elon Musk, presidente de Tesla (coches eléctricos), SolarCity y SpaceX (tecnología espacial), así como el nobel de Física Frank Wilczek, el cofundador de Skype, Jaan Tallinn y el cofundador de Apple, Steve Wozniak.

Stephen Hawking y otros científicos piden la prohibición de los "robots asesinos"

A diferencia de los drones, que necesitan una intervención humana, los "robots asesinos" pueden tomar decisiones de manera autónoma y preocupan tanto a la ONU como a la comunidad científica y humanitaria, que ya han mantenido dos reuniones de expertos sobre la cuestión en Ginebra.

Los más críticos con estas armas apuntan a que no distinguen entre civiles y combatientes y podrían programar ataques con efectos desproporcionados para la población civil.

Desde el punto de vista militar, estas armas tienen la ventaja de reducir las pérdidas humanas en el campo de batalla pero los científicos recuerdan que eso abarataría el coste de ir a la guerra y podría provocar una nueva carrera armamentística.

"A diferencia de las armas nucleares, no requieren materias primas costosas o difíciles de obtener (...) Sólo será cuestión de tiempo hasta que aparezcan en el mercado negro y en las manos de los terroristas (..) Y se?ores de la guerra que deseen perpetrar limpiezas étnica, etc." dice el texto.

La inteligencia artificial "tiene un gran potencial para beneficiar a la humanidad" pero "el inicio de una carrera armamentista de IA militar es una mala idea".

Existe un precedente de prohibición de armas que todavía no existen, cuando en 1998 se prohibieron las armas láser cegadoras antes de que empezaran a ser producidas en masa.

Las 10 compa?ías chinas con más ingresos en 2015

Las 10 compa?ías chinas con más ingresos en 2015

Los 10 servicios que han cambiado con el modelo O2O

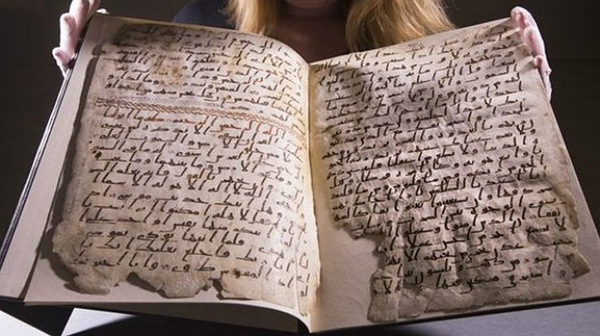

Los 10 servicios que han cambiado con el modelo O2O Encuentran el manuscrito del Corán más antiguo jamás conocido

Encuentran el manuscrito del Corán más antiguo jamás conocido Vestir el paisaje de Sichuan

Vestir el paisaje de Sichuan Rara porcelana imperial se exhibe por primera vez en el Museo Capitalino

Rara porcelana imperial se exhibe por primera vez en el Museo Capitalino

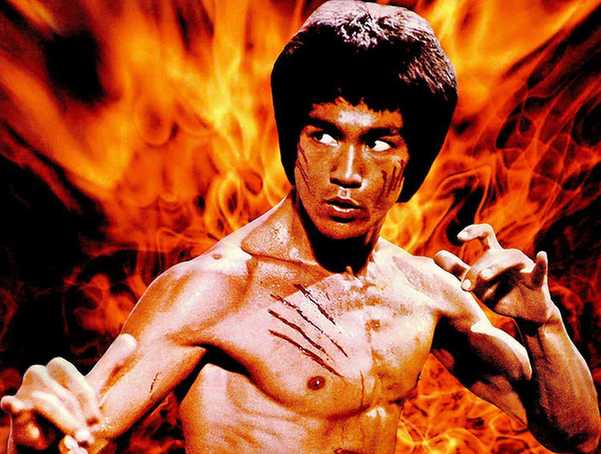

Las 20 estrellas del kung fu en China

Las 20 estrellas del kung fu en China

10 películas chinas de animación

para disfrutar este verano

10 películas chinas de animación

para disfrutar este verano Los reality shows de China deben abstenerse de mostrar vulgaridad y vanidad

Los reality shows de China deben abstenerse de mostrar vulgaridad y vanidad Cirujanos chinos salvan la mano de un paciente pegándosela a la pierna

Cirujanos chinos salvan la mano de un paciente pegándosela a la pierna